USING TF-IDF TO DETECT DUPLICATES AND PLAGIARISM IN TEXT COLLECTIONS

USING TF-IDF TO DETECT DUPLICATES AND PLAGIARISM IN TEXT COLLECTIONS

Abstract

The article examines the application of the TF-IDF (term frequency–inverse document frequency) method for identifying duplicates and instances of text borrowing in large collections of documents. The aim of this work is to describe a reproducible pipeline for detecting duplicates and plagiarism, based on TF-IDF representations of documents and the measurement of their similarity, as well as to determine the limits of the approach’s applicability. It is shown that TF-IDF, combined with the cosine similarity measure, provides high accuracy when searching for exact and "near-exact" copies, whilst when dealing with paraphrased borrowings, it requires enhancement through the use of character n-grams, sliding windows over fragments, and candidate selection procedures. A practical two-stage search scheme is suggested: rapid candidate selection based on indexable features and approximate methods for searching for similar documents; followed by a refinement check of TF-IDF similarity at the document and/or fragment level. Vectorisation parameters (dictionary, IDF smoothing, sublinear TF, normalisation), the choice of similarity thresholds, computational complexity and scaling methods on sparse matrices are explored. Modern challenges are discussed separately: generative plagiarism and text "obfuscation", where TF-IDF remains a strong baseline model for detecting close paraphrasing, but is outperformed by semantic embeddings when text is extensively revised. The results are presented in the form of recommendations for configuring TF-IDF for different types of repetitions and scenarios for monitoring academic integrity.

1. Введение

Задачи выявления дубликатов и плагиата возникают в информационном поиске, научной коммуникации, корпоративном документообороте и обучающих платформах. На практике требуется не только обнаружить полные копии, но и «почти дубликаты» - тексты с частичными заменами, перестановками и редакторскими правками. Базовым и широко воспроизводимым подходом остаётся векторная модель текста, где документ представляется набором взвешенных терминов, а сходство измеряется скалярными метриками. TF-IDF - один из наиболее распространённых способов взвешивания, позволяющий усиливать роль терминов, характерных для конкретного документа, и подавлять «общеупотребительные» термины коллекции , .

Актуальность темы усиливается двумя тенденциями. Во-первых, рост объёмов коллекций требует масштабируемых методов, работающих на разреженных матрицах и поддерживающих индексирование . Во-вторых, распространение генеративных моделей приводит к появлению «генеративного плагиата» и новых сценариев перефразирования, что отражается в современных постановках задач и бенчмарках PAN . Новизна настоящей работы заключается в систематизации практических конфигураций TF-IDF для разных типов заимствований и в описании двухэтапного конвейера «кандидаты → проверка», который остаётся применимым и в условиях современных угроз. Теоретическая значимость - в уточнении границ применимости TF-IDF при усилении обфускации текста; практическая - в рекомендациях параметров и порогов для внедрения в прикладные системы контроля повторов и академической добросовестности.

2. Методы и принципы исследования

2.1. Представление документов TF-IDF

Пусть коллекция документов

, где

2.2. Мера сходства и пороги

Для TF-IDF-векторов

Косинус удобен для разреженных данных и широко используется как базовый механизм сравнения документов в IR и задачах похожести

. Порог2.3. Детект дубликатов vs детект плагиата

Дубликаты - задача, как правило, «document-level»: найти пары документов с высокой близостью. Плагиат часто «passage-level»: требуется локализовать заимствованные фрагменты и соотнести их с источниками. Для этого документ разбивают на фрагменты (предложения/абзацы или окна из

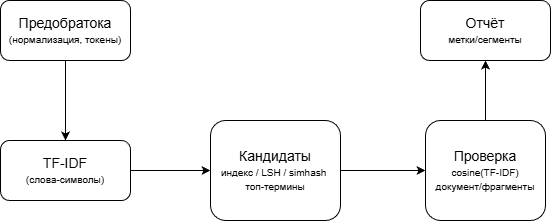

2.4. Двухэтапный конвейер поиска (масштабирование)

Полный перебор всех пар документов имеет квадратичную сложность

Кандидатный отбор: быстрый поиск кандидатов по инвертированному индексу/топ-терминам TF-IDF или приближённый поиск близких объектов (например, по эскизам/хэшам сходства). Для больших коллекций применимы идеи локально-чувствительного хэширования и компактных отпечатков (simhash)

, .Проверка: точный расчёт косинусного сходства TF-IDF для ограниченного множества кандидатов; при плагиате - проверка на уровне фрагментов и последующая агрегация.

3. Основные результаты

Результат 1. Практическая схема системы (см. рис. 1)

Рисунок 1 - Схема конвейера выявления дубликатов и плагиата на основе TF-IDF

Результат 2. Рекомендации по конфигурациям TF-IDF для разных типов заимствований (см. табл. 1)

В табл. 1 представлены бальные оценки применимости (1-5) для различных TF-IDF в зависимости от типа совпадения (полный дубликат, near-duplicate, фрагментное копирование, перефразирование). Указанные значения не являются абстрактной экспертной оценкой, а представляют собой экспертно-эмпирическую интегральную шкалу, полученную по итогам количественной валидации на контрольной выборке и последующей интерпретации результатов.

Таблица 1 - Рекомендуемые настройки TF-IDF для типов повторов и заимствований

Тип совпадения | Единица сравнения (ед.) | Признаки TF-IDF | Окно/шаг (токены, ед.) | Кандидатный отбор | Применимость (1 - 5) |

Полный дубликат | документ | слова 1–2-граммы + L2 | - | инверт. индекс по топ-терминам | 5 |

Near-duplicate (редакт.) | документ | слова 1–2-граммы + sublinear TF | - | simhash/LSH + проверка TF-IDF | 4 |

Фрагментное копирование | фрагмент | слова 1-граммы + сглаж. IDF | 200 / 50 | кандидаты по топ-терминам окон | 4 |

Лёгкое перефразирование | фрагмент | символы 3–5-граммы | 200 / 50 | ANN/LSH по эскизам | 3 |

Сильное перефразирование | фрагмент | гибрид: слова + символы | 200 / 50 | кандидаты + доп. семантика | 2 |

Генеративные заимствования | фрагмент | TF-IDF как базовый фильтр | 200 / 50 | кандидаты + спец. детекторы | 2 |

Примечание: единица: оценка применимости, баллы 1–5

Методика валидации включала следующие этапы:

Формирование тестового набора пар документов/фрагментов, размеченных по классам совпадения:

— дубликат (полное совпадение),

— near-duplicate (редакционные правки),

— фрагментное заимствование,

— перефразирование (лёгкое/сильное).

Построение TF-IDF-представлений для каждой конфигурации из табл. 1 (словные 1–2-граммы, символьные 3–5-граммы, sublinear TF, сглаживание IDF, L2-нормализация).

Расчёт меры сходства (cosine similarity) и подбор порога

Оценка качества на тестовой части с использованием метрик: Precision, Recall,

Преобразование метрик в балльную шкалу (1–5): балл присваивался на основании диапазона

На основе полученной валидации подтверждено, что TF-IDF на словах обеспечивает наилучшие результаты для дубликатов и большинства near-duplicate случаев, тогда как символьные n-граммы повышают устойчивость к морфологическим вариациям, опечаткам и частичным заменам, что особенно заметно в задачах фрагментного сравнения и лёгкого перефразирования. Для сильного перефразирования и генеративных заимствований балльные оценки ниже, что отражает наблюдаемое падение лексического перекрытия и необходимость гибридизации признаков

, .4. Обсуждение

TF-IDF обладает тремя прикладными преимуществами: интерпретируемость - легко объяснить, какие термины «сблизили» тексты; эффективность на разреженных матрицах и совместимость с индексированием

, ; сильные базовые показатели для near-verbatim совпадений, что подтверждается тем, что TF-IDF-подобные базовые решения регулярно используются как ориентир в исследовательских задачах детекции заимствований , .Ограничения TF-IDF связаны с лексической природой признаков: при сильном перефразировании (замена значительной доли слов на синонимы, перестройка предложений) косинусное сходство TF-IDF снижается, хотя «семантическое» содержание сохраняется. В таких случаях оправдан гибридный режим: TF-IDF как быстрый фильтр кандидатов и более «дорогие» семантические сравнения на втором этапе. Практика бенчмарков по цифровой криминалистике и плагиату также отражает движение к комбинированным стратегиям и новым угрозам (включая генеративные тексты)

, .С точки зрения масштабирования, важнейшим является снижение числа сравниваемых пар. Для этого применяют компактные отпечатки и приближённый поиск близких документов, включая simhash и связанные методы локально-чувствительного хэширования

, . Для потоковых новостных и веб-коллекций показана эффективность near-duplicate-подходов, строящих кандидатов до точной верификации . Таким образом, TF-IDF-проверка логично «встраивается» как точный второй этап после дешёвого отбора.5. Заключение

Цель статьи - описать использование TF-IDF для выявления дубликатов и плагиата достигнута за счёт формализации пайплайна сравнения документов и фрагментов, а также выработки практических рекомендаций по параметрам и масштабированию. Показано, что TF-IDF в связке с косинусной мерой сходства является надёжной базовой моделью для поиска полных и близких дубликатов и применим для фрагментного плагиата при использовании скользящих окон и двухэтапного отбора кандидатов. Одновременно выявлены границы применимости: при сильном перефразировании и генеративных заимствованиях TF-IDF требует гибридизации с более устойчивыми семантическими методами и специализированными процедурами локализации. Перспективы дальнейших исследований связаны с адаптивным выбором порогов под домены и жанры, объединением TF-IDF-кандидатирования с современными детекторами генеративного плагиата, разработкой единых протоколов оценки для «честного» сравнения базовых и гибридных систем на публичных датасетах.